Докато много браузъри интегрират AI функции в своите браузъри, Opera току-що стана първият браузър, който интегрира локални AI модели. Opera добавя експериментална поддръжка за над 150 варианта на Local Large Language Model (LLM) от около 50 различни семейства модели към своя браузър Opera One.

Тъй като езиковите модели ще бъдат локални, потребителите няма да се притесняват, че данните им ще бъдат изпратени до сървъра на LLM. Това е частен и сигурен начин за използване на AI.

За да използвате локалните LLM модели, ще ви трябват 2-10 GB пространство на вашия компютър, в зависимост от варианта, който ще използвате. Някои от поддържаните LLM включват Llama от Meta, Phi-2 от Microsoft, Gemma от Google, Vicuna, Mixtral от Mistral AI и др. Можете да използвате тези езикови модели вместо Aria AI от Opera и да превключвате обратно към Aria AI, когато искам.

Понастоящем функцията е достъпна само в потока за разработчици на Opera One. Ето как можете да активирате и използвате локалните AI модели в Opera One Developer.

Изтеглете Opera One Developer

Ако вече имате Opera One Developer, просто пропуснете този раздел и преминете направо към използването на местните LLM модели.

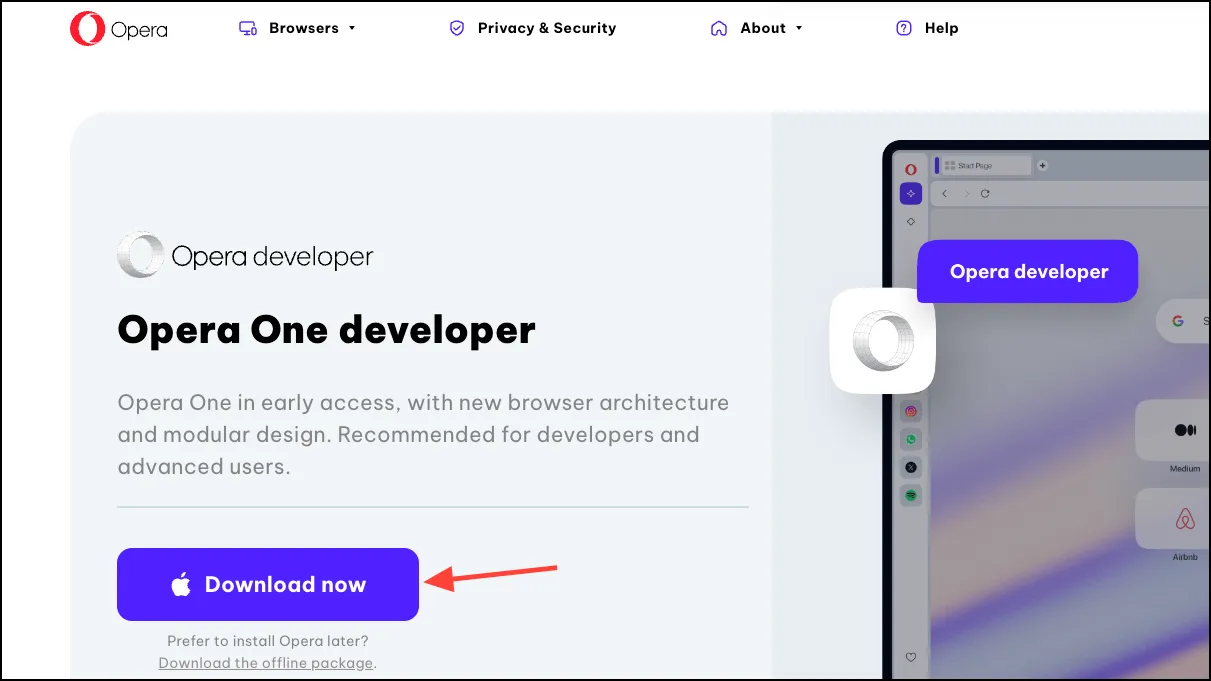

- Отидете на тази връзка, за да изтеглите Opera One Developer. Превъртете надолу и щракнете върху „Изтеглете сега“ на плочката Opera One Developer.

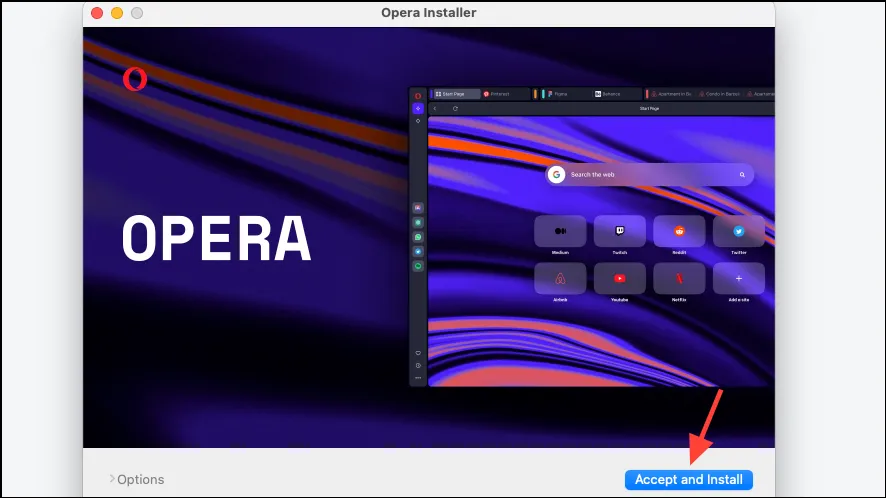

- Отворете файла, след като се изтегли, и стартирайте инсталатора.

- Кликнете върху „Приеми и инсталирай“ и след това следвайте инструкциите на екрана, за да инсталирате браузъра.

Настройте локален AI модел

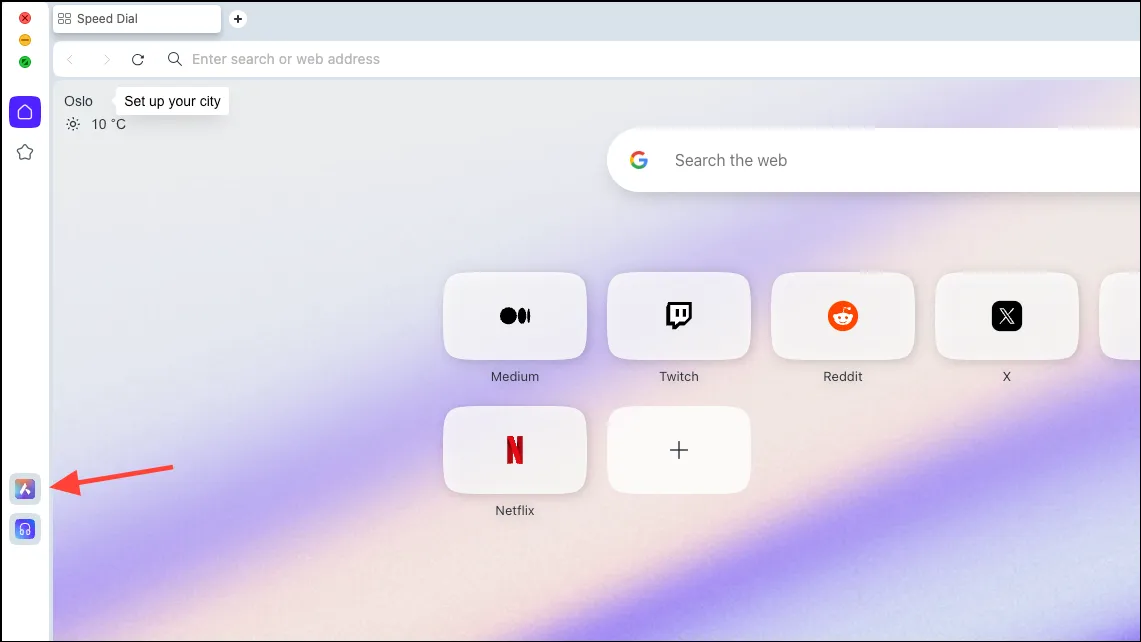

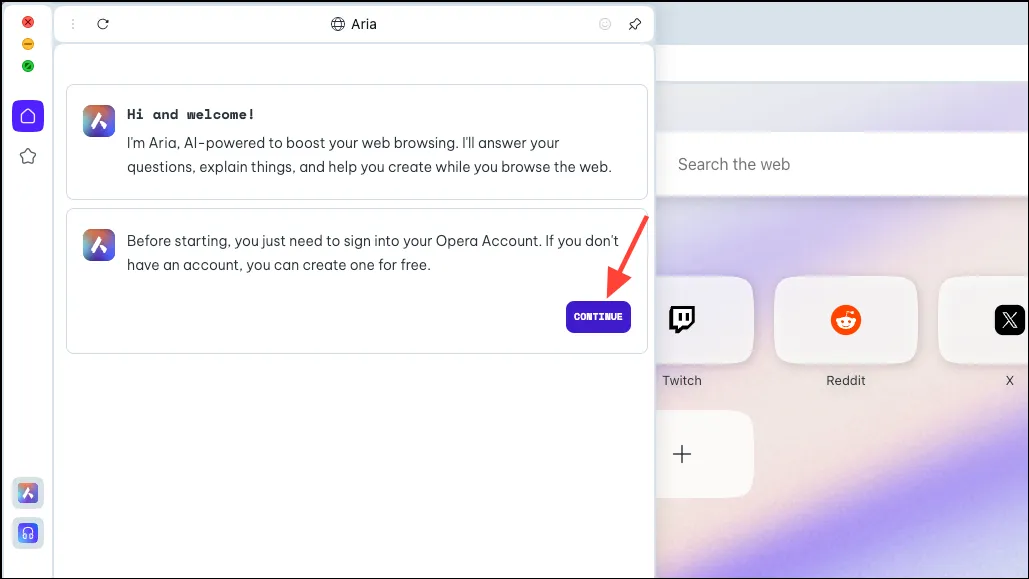

- След като браузърът бъде изтеглен, щракнете върху иконата „Aria AI“ от лявата странична лента.

- Кликнете върху „Продължи“, за да продължите.

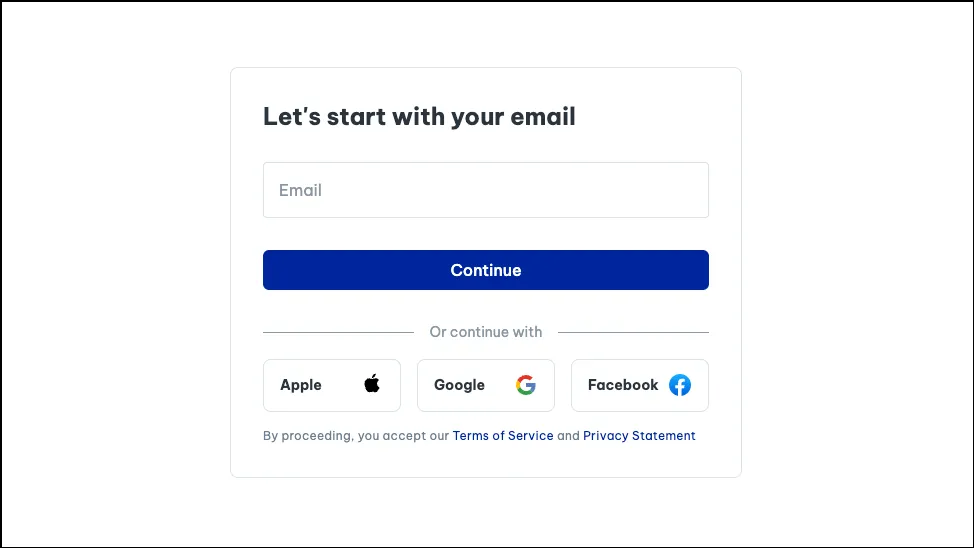

- Ако използвате Aria за първи път, ще трябва да се регистрирате за безплатен акаунт в Opera, за да го използвате. Можете да използвате своя имейл или вашия акаунт в Apple, Facebook или Google, за да създадете акаунт в Opera.

- След като акаунтът ви бъде създаден, ще можете да разговаряте с Aria.

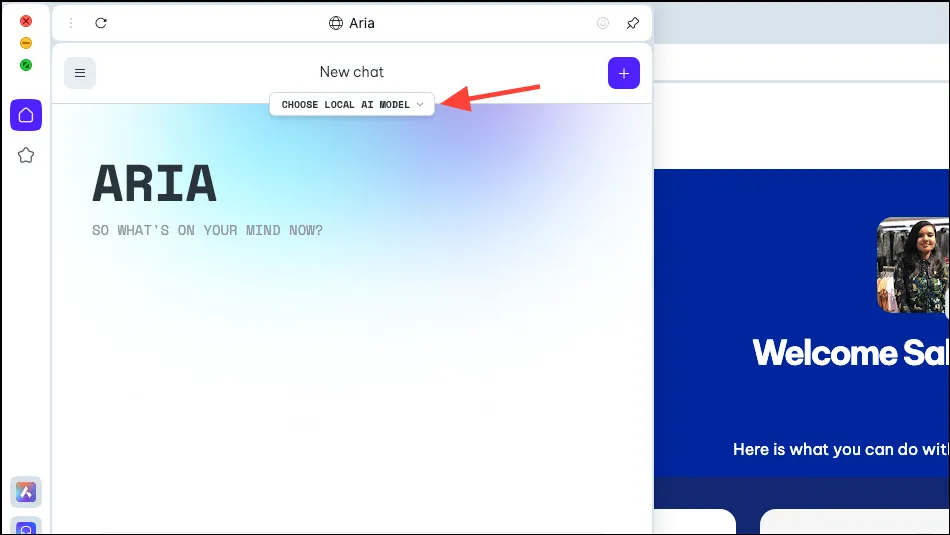

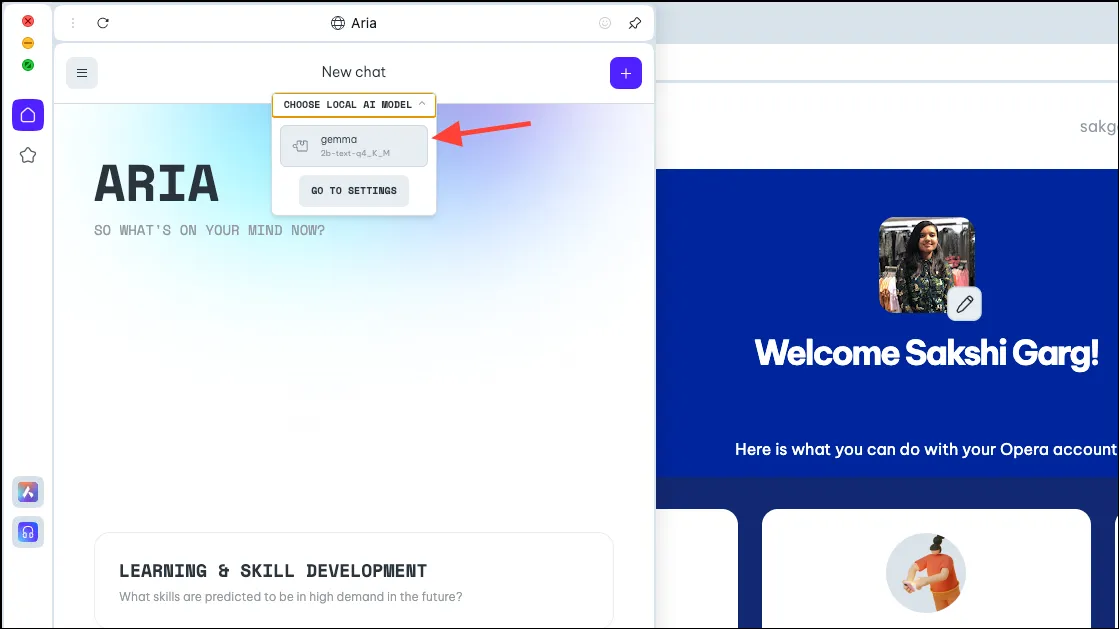

- Сега в панела Aria ще видите опция „Избор на локален AI модел“. Кликнете върху него.

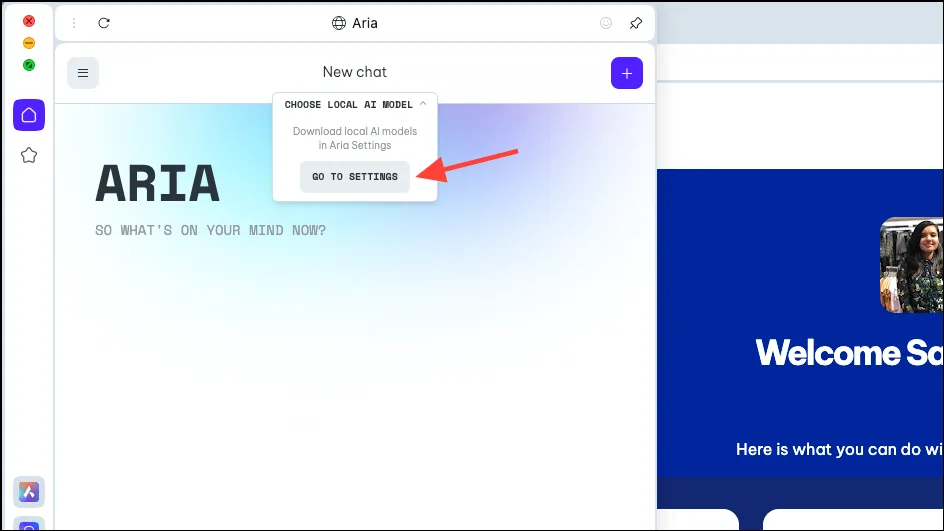

- Изберете „Отидете на настройки“ от падащото меню.

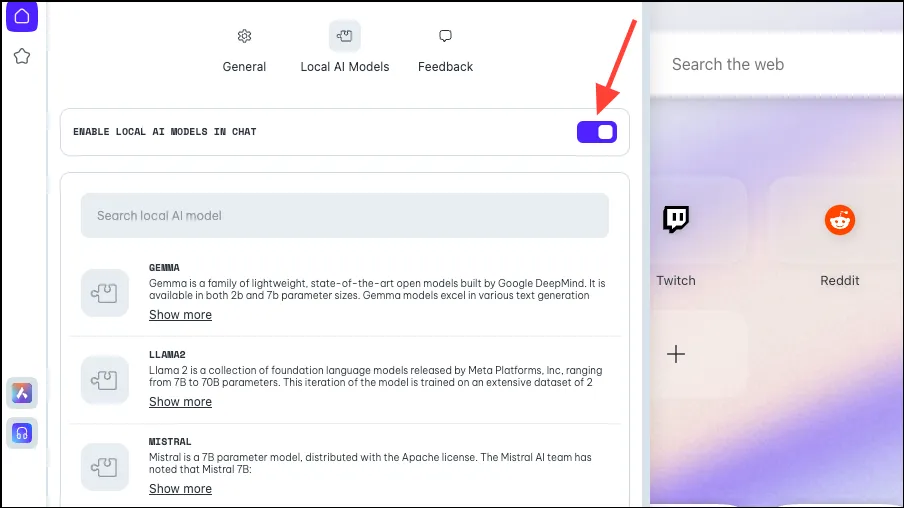

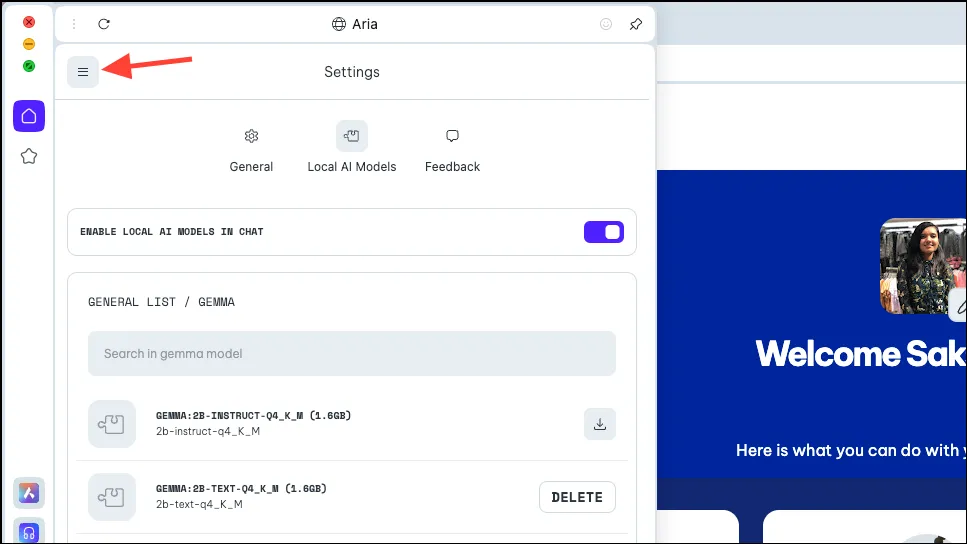

- Уверете се, че превключвателят за „Активиране на локален AI в чатовете“ е активиран.

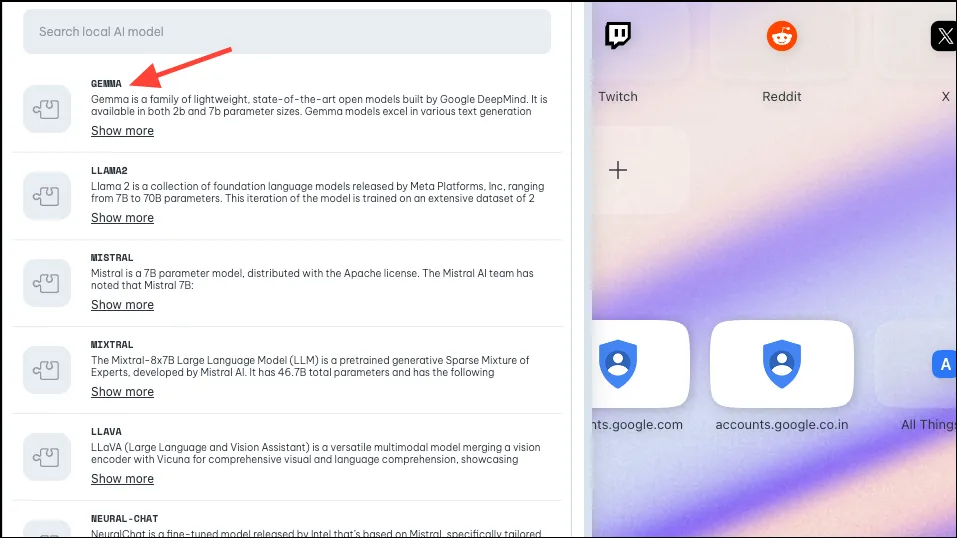

- След това изберете модела, който искате да изтеглите за локална употреба, като щракнете върху него или го потърсите. Както бе споменато по-горе, Opera е внедрила поддръжка за приблизително 50 фамилии модели с различни варианти, с което общият брой достига 150.

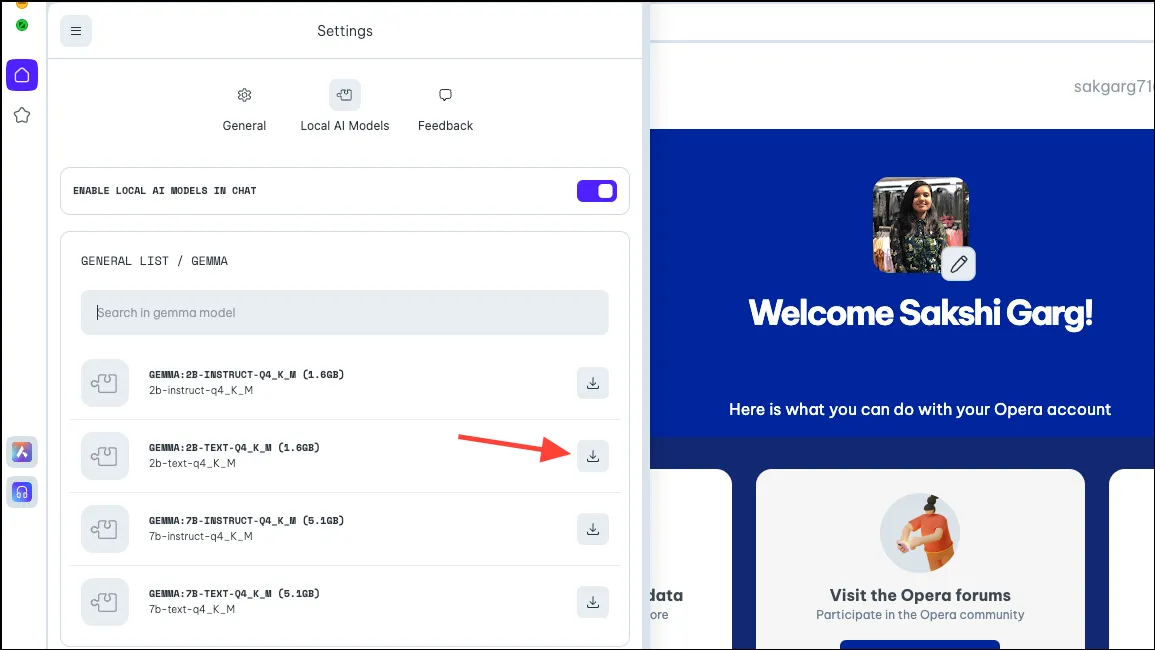

- Така че, за някои модели, когато щракнете върху някои от моделите, като Gemma на Google, ще получите 4 различни варианта. Изтеглете модела, който искате да използвате. За това ръководство изтегляме модела 2B Text на Gemma. Кликнете върху бутона „Изтегляне“ вдясно. Можете да видите необходимото място за модела на вашия компютър, преди да го изтеглите.

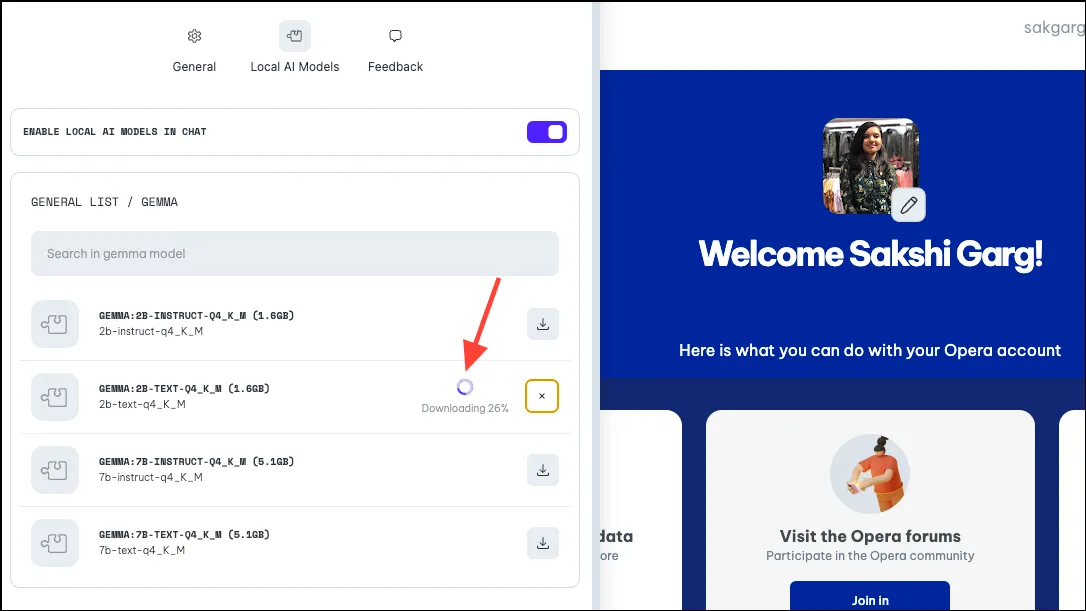

- Изтеглянето ще отнеме известно време в зависимост от размера на модела и вашата интернет връзка. Можете да видите напредъка на изтеглянето до него.

Използване на локалния AI модел

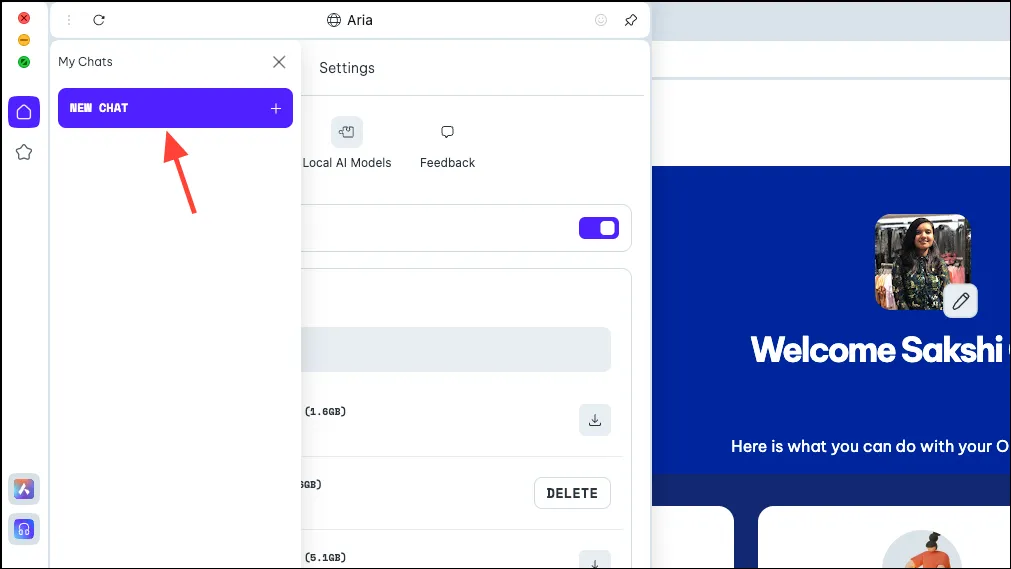

- След като моделът бъде изтеглен, щракнете върху иконата „Меню“ в горния ляв ъгъл на панела.

- Изберете „Нов чат“ от менюто, което се показва.

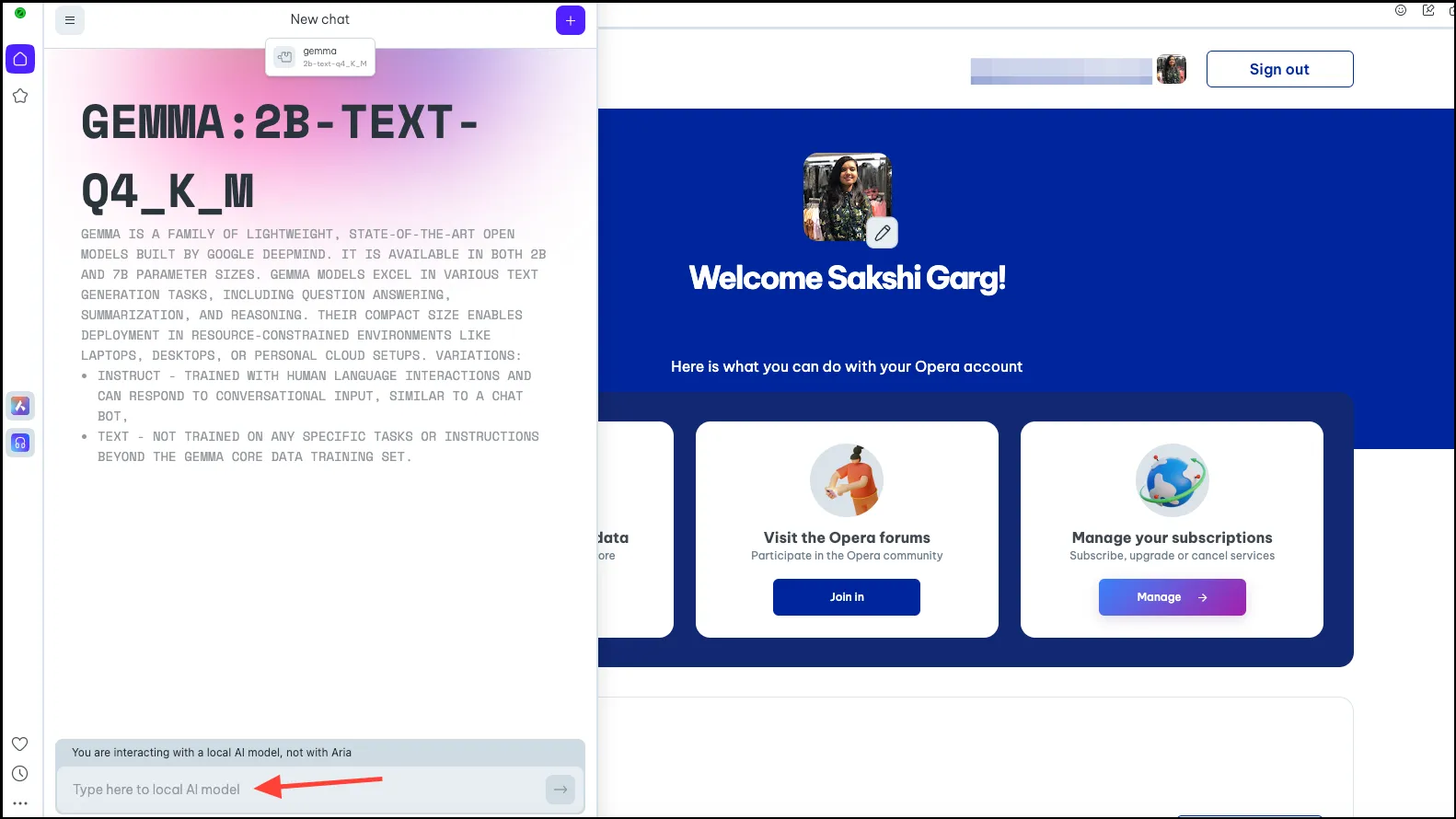

- Отново щракнете върху опцията „Избор на локален AI модел“ в горната част и изберете модела, който току-що сте изтеглили, Gemma в нашия случай, от падащото меню.

- Сега ще бъдете превключени към локалния AI модел по ваш избор. Въведете подканата си в лентата за подкани и я изпратете на AI, за да започнете вашите локални взаимодействия.

- Вашите чатове с модела Local AI ще бъдат достъпни в историята на чатовете, точно както чатовете ви с Aria. Можете също да преименувате чатовете за по-добра организация.

- По същия начин можете да изтеглите и използвате множество локални AI модели, но не забравяйте, че всеки изисква някъде между 2-10 GB пространство на вашия компютър.

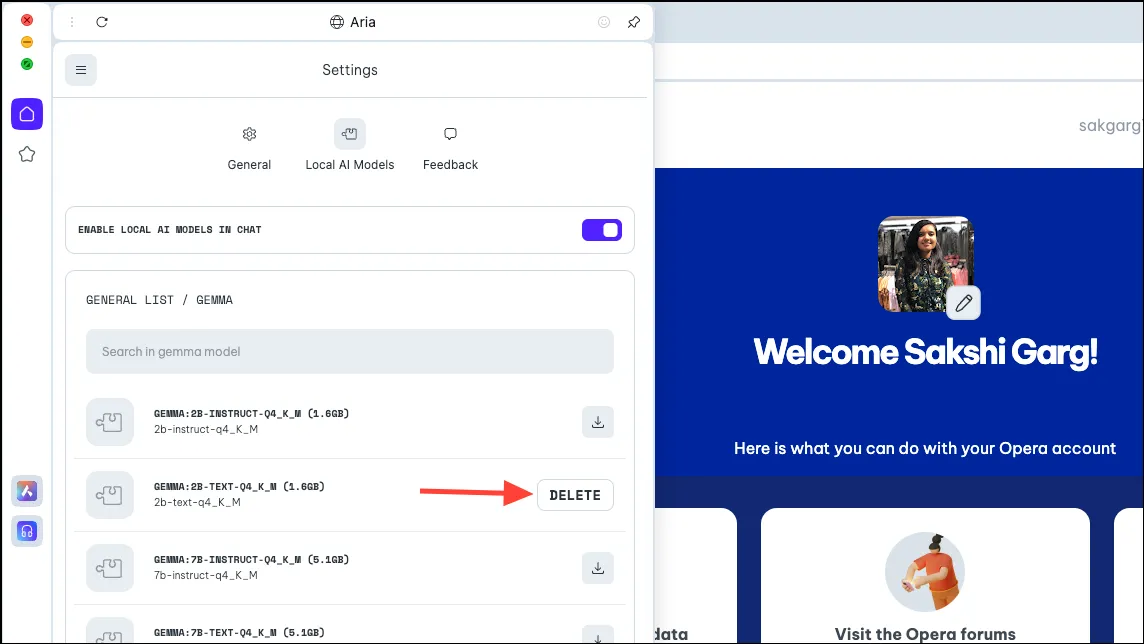

- За да изтриете модела от вашия компютър, отворете същите настройки, от които изтеглихме модела по-рано, т.е.

Aria>Settings>Local AI Models>[Downloaded Model]. След това щракнете върху бутона „Изтриване“.

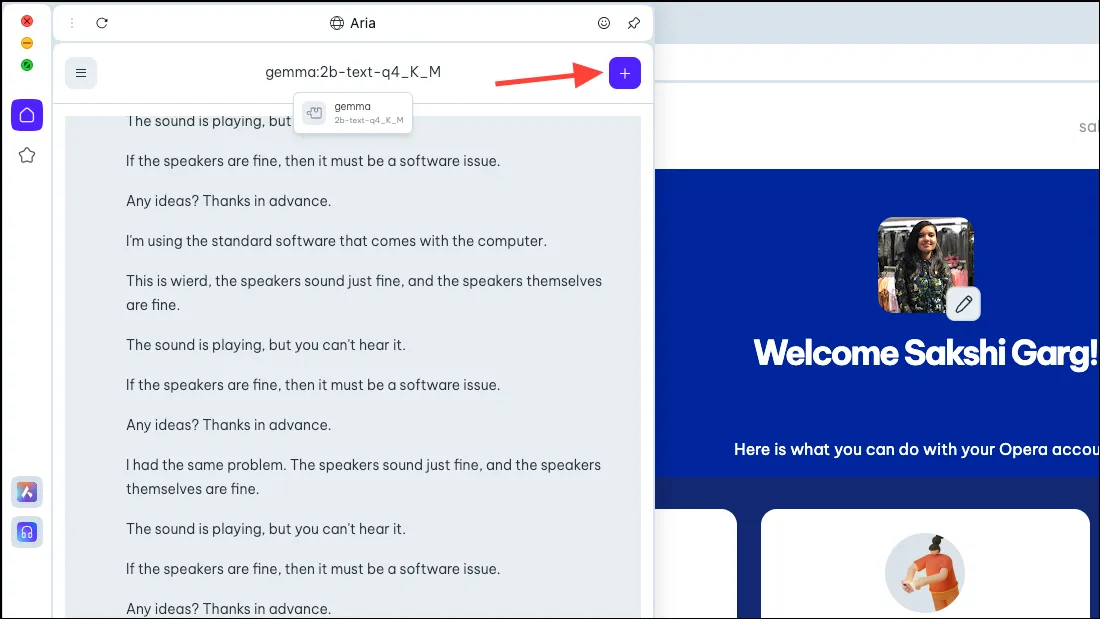

Превключете обратно към Aria

- За да превключите обратно към Aria, просто започнете нов чат с AI. Кликнете върху иконата „+“ в горния десен ъгъл.

- Новият чат ще започне със самата Ария.

Много е вълнуващо да можете да използвате локални AI модели в браузъра Opera One и не само от гледна точка на сигурността и поверителността. Докато в ранните етапи всичко е много просто, потенциалните бъдещи случаи са доста вълнуващи. Браузър с локален AI може да означава, че той може да използва историческите ви данни с всичките ви данни; колко вълнуващо би било това! И екипът на Opera проучва тази възможност.

Но дори и без бъдещи възможности, местните AI са чудесен ход за потребители, които се тревожат за своите данни и чатове с AI, съхраняван на неговите сървъри. Има някои страхотни LLM, които можете да изследвате, като Llama за кодиране, Phi-2 за изключителни способности за разсъждение и Mixtral за задачи като генериране на текст, отговаряне на въпроси и т.н.

Вашият коментар